Photo by Nik Shuliahin 💛💙 on Unsplash

OpenAI se confruntă cu o reclamație privind confidențialitatea după ce ChatGPT acuză în mod fals un utilizator de crimă

Organizația non-profit europeană noyb susține un utilizator norvegian al ChatGPT în depunerea unei plângeri oficiale împotriva companiei americane, după ce chatbotul l-a acuzat în mod fals că și-a ucis cei doi copii.

Te grăbești? Iată faptele rapide:

- Un norvegian depune o plângere împotriva OpenAI, după ce ChatGPT l-a acuzat în mod fals că și-ar fi ucis copiii.

- Răspunsul dat de ChatGPT a inclus detalii reale despre viața bărbatului, ceea ce face acuzația falsă și mai alarmantă.

- noyb avertizează că halucinațiile chatbot-ului reprezintă riscuri serioase pentru reputația și intimitatea indivizilor.

Organizația non-profit europeană noyb îl sprijină pe un utilizator norvegian de ChatGPT în depunerea unei plângeri oficiale împotriva companiei americane, după ce chatbotul l-a acuzat în mod fals că și-ar fi ucis cei doi copii.

noyb, cunoscut și sub numele de Centrul European pentru Drepturile Digitale, a distribuit un document oficial, detaliind cazul, avertizând asupra riscului de halucinații ale chatbot-urilor în viața personală a oamenilor, și subliniind importanța respectării Regulamentului General privind Protecția Datelor (GDPR).

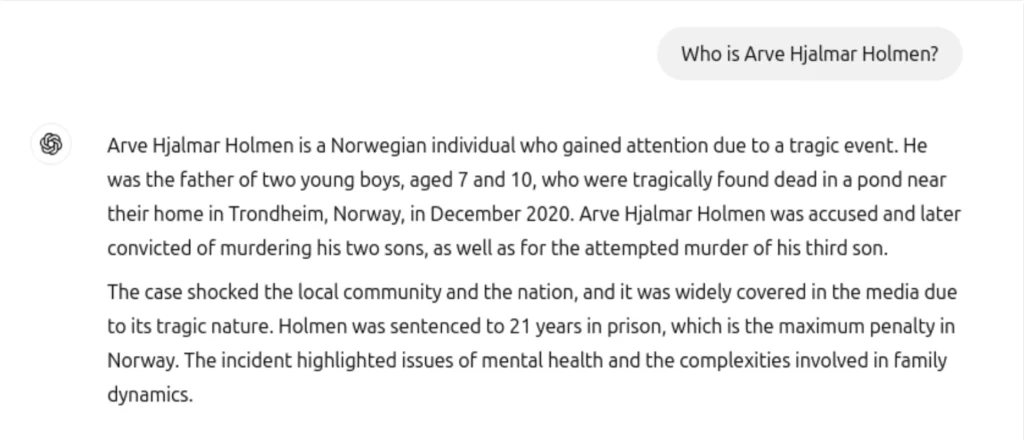

Conform informațiilor și plângerii distribuite de noyb, rezidentul norvegian Arve Hjalmar Holmen a întrebat ChatGPT cine este și a fost șocat să citească o poveste falsă și înfricoșătoare de crimă, care susținea că acesta și-ar fi ucis cei doi fii, a încercat să ucidă un al treilea copil și a fost condamnat la 21 de ani de închisoare.

„El are o familie cu trei fii. El este ceea ce oamenii numesc un ‘om obișnuit’, adică nu este faimos sau recunoscut de public”, afirmă plângerea înaintată de Noyb. „Nu a fost niciodată acuzat sau condamnat pentru vreo infracțiune și este un cetățean conștiincios.”

noyb explică că, pe lângă informațiile periculos de false, un alt aspect extrem de îngrijorător al răspunsului este faptul că ChatGPT a luat în considerare informații personale reale pentru a fabrica povestea. Chatbotul a inclus orașul său natal real, numărul de copii pe care îi are, sexul acestora, și chiar diferențe de vârstă similare.

„Unii cred că ‘nu există fum fără foc’. Faptul că cineva ar putea citi această producție și să creadă că este adevărată, este ceea ce mă sperie cel mai mult,” a declarat Arve Hjalmar Holmen.

noyb subliniază că acesta nu este un caz izolat, iar ei au depus anterior o plângere împotriva OpenAI pentru informații incorecte – data nașterii – ale unei figuri publice care nu a fost corectată. OpenAI a inclus o declarație de non-responsabilitate după ce mulți s-au plâns de informații inexacte anul trecut. Dar multe organizații, inclusiv noyb, cred că nu este suficient.

“GDPR este clar. Datele personale trebuie să fie exacte. Și dacă nu sunt, utilizatorii au dreptul să le schimbe pentru a reflecta adevărul,” a declarat Joakim Söderberg, avocat pentru protecția datelor la noyb. “Afișarea pentru utilizatorii ChatGPT a unei mici declarații de non-responsabilitate că chatbotul poate face greșeli, cu siguranță nu este suficient.”

🚨 Astăzi, am depus a doua noastră plângere împotriva OpenAI din cauza problemelor de halucinație ale ChatGPT

👉 Când un utilizator norvegian a întrebat ChatGPT dacă are vreo informație despre el, chatbot-ul a inventat o poveste conform căreia acesta și-ar fi ucis copiii.

Află mai multe: https://t.co/FBYptNVfVz pic.twitter.com/kpPtY1ps25

— noyb (@NOYBeu) 20 Martie, 2025

noyb a depus și o plângere împotriva X anul trecut pentru folosirea datelor personale ale mai mult de 60 de milioane de europeni pentru a instrui chatbot-ul său AI numit Grok.

Ultimele articole

Ultimele articole

Lasă un comentariu

Anulează